Denken oder übersetzen

Geschrieben am 05.06.2018 von HNF

Die Künstliche Intelligenz, kurz KI, zieht das besondere Interesse des Publikum und der Medien auf sich. Am Donnerstag, den 14. Juni, spricht Marc Rohlfing im HNF darüber; sein Vortrag trägt den Titel „Endlich! Intelligente Computer“. Zur Einstimmung möchten wir einen Bereich der KI betrachten, den man auch am heimischen Computer erleben kann: die automatische Sprachübersetzung.

Künstliche Intelligenz – wer kennt sie nicht. Abgekürzt als KI und gleichbedeutend mit der amerikanischen Artificial Intelligence, machte das Teilgebiet der Informatik in jüngster Zeit große Fortschritte. Verantwortlich dafür war eine neuartige Methode zur Simulation von Denkleistungen, das sogenannte Deep Learning. Das tiefe Lernen wiederum basiert auf künstlichen neuronalen Netzen. Das sind Computerprogramme, welche durch die Vernetzung unserer Gehirnzellen inspiriert wurden.

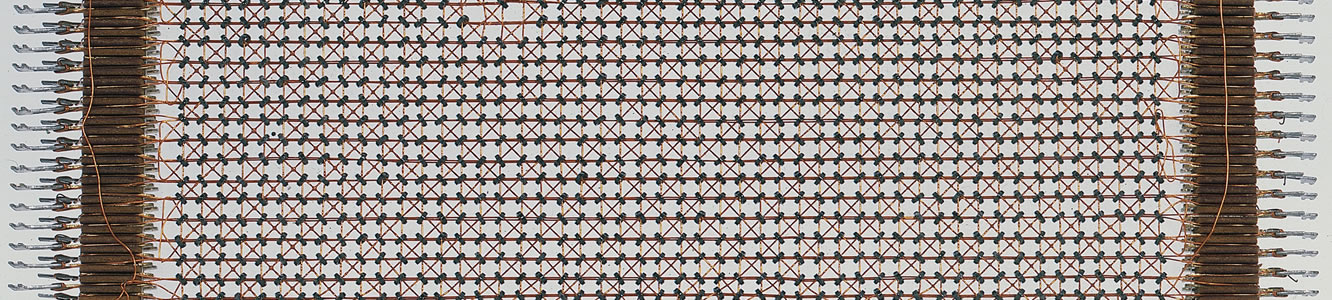

Ein künstliches Neuronennetz ist eine Art Rechenmaschine. Es besteht aus Knoten oder Zellen, die in Schichten aufgereiht sind. Von den Zellen einer Schicht strömen Zahlen zu Knoten der Nachbarschicht oder in die Ausgangszelle zurück. Beim Eintritt in einen Knoten können die Werte mit einer Konstanten multipliziert werden. In den 1950er- und 1960er-Jahren entstanden zunächst fest verdrahtete Systeme wie das Perceptron in den USA oder die Lernmatrix der TH Karlsruhe. Später wurden die Netze meist als Software realisiert.

Das HNF zeigt im Bereich „Künstliche Intelligenz und Robotik“ ein künstliches neuronales Netz. Es identifiziert Münzen von Cent bis Euro anhand des Klangs, der beim Fall auf eine Kachel entsteht. Dabei werden die Schallwellen mit einem Mikrofon aufgenommen und digitalisiert. Die Bits gehen ans Netz-Programm, das sofort weiß, welches Geldstück gerade „Ping“ gemacht hat. Voraussetzung sind die Durchläufe in der Lernphase des Netzes, in der die Parameter der Netzverbindungen justiert werden.

Künstliche neuronale Netze eignen sich besonders gut für das Erkennen von Mustern. Das können Geräusche sein wie oben geschildert, handgeschriebene Ziffern, bunte Katzenbilder, Positionen von Go-Figuren oder Sätze einer Sprache. Solche Sätze sind ebenfalls Muster: Sie bestehen aus Elementen, sprich Worten, die sich nach bestimmten Regeln gruppieren. Wenn man die Sätze zweier unterschiedlicher Sprachen betrachtet, so lassen sich zwischen ihnen Beziehungen finden, zum Beispiel Paare von Sätzen mit gleichem Sinngehalt.

Damit sind wir beim Einsatz unserer Netze für Online-Übersetzungen angelangt. Die nötigen sprachlichen Zusammenhänge muss das neuronale Netz zuerst erlernen, hauptsächlich durch die statistische Analyse von bereits vorhandenen menschlichen Übersetzungen. So sammelten Linguisten aus Edinburgh Sitzungsprotokolle des Europäischen Parlaments in den verschiedenen EU-Sprachen und stellten sie der KI-Forschung zur Verfügung.

2006 startete Google seinen Dolmetscherdienst. Zu Beginn ließen die Übersetzungen oft zu wünschen übrig, etwa wenn Iwan der Schreckliche als Abraham Lincoln ausgegeben wurde. Im November 2016 erschien die Google Neural Machine Translation GNMT. Sie verbesserte die Qualität des Dienstes ganz erheblich. Seit August 2017 bietet auch die Kölner Firma DeepL neuronale Online-Übertragungen an, die allseits gelobt wurden. Damit können wir zwei Spitzenprodukte der KI nutzen und ihnen zugleich ein wenig auf den Zahn fühlen.

Wie intelligent sind die intelligenten Systeme also? Nützlich sind sie auf jeden Fall, schwere Fehler kommen kaum noch vor. Doch der Teufel liegt im Detail, was das Shakespeare-Zitat „The rest is silence“ beweist. Sowohl Google als auch DeepL setzen Der Rest ist Stille, der deutsche Dienst bringt noch Der Rest ist Schweigen als Alternative. „The Silence of the Lambs“ wird bei Google zu „Das Schweigen der Lämmer“, während DeepL wiederum die Stille bevorzugt. Das Programm nennt aber „Das Schweigen der Lämmer“ als Alternative.

Englisch-Deutsch-Übersetzungen haben ein Problem: Heißt es Sie oder Du? Aus „Do not touch the wire“ macht Google „Berühren Sie nicht den Draht“; aus „Do not touch my girl“ wird „Fass meine Freundin nicht an“. Richtig so! Doch betrachten wir den berühmten Satz von John F. Kennedy: „And so, my fellow Americans: ask not what your country can do for you – ask what you can do for your country.” Hier kommt das schräge „Und so, meine amerikanischen Landsleute: Frag nicht, was dein Land für dich tun kann – frag, was du für dein Land tun kannst.“ DeepL kann es nach einer kleinen Denkpause besser.

Ein spezielles Kapitel bildet die Umgangssprache. „Er ist auf dem falschen Dampfer“ führt zum wrong steamer und wrong boat – DeepL kennt aber die Nebenbedeutung. Auf den amerikanischen Stoppbefehl „Freeze!“ reagiert der Google-Übersetzer mit der Aufforderung zum Einfrieren. Der Kölner Konkurrent übersetzt ihn korrekter mit „Stehen bleiben!“ und „Keine Bewegung!“. Bei den Four-Letter Words geben beide Dienste offen und ehrlich Auskunft; auf Beispiele müssen wir aus begreiflichen Gründen verzichten.

Die neuronalen Programme haben Zugriff auf viele Worte und Wendungen, doch sie wissen nicht, wovon sie reden. Auch Menschen vertiefen ihre Sprachkenntnisse mit Texten, durch Lektüre, Audiobücher oder Radiosendungen. Das wichtigste Training ist aber das Erlernen des Sprachgebrauchs in der Realität, und diese bleibt den Übersetzungsdiensten versperrt. Einst schufen KI-Forscher virtuelle Welten, über die sie mit dem Computer kommunizierten; ein schönes Programm war SHRDLU. Beim Übersetzen hilft diese Pionierleistung nicht.

Über die Gefahr, dass die Denkmaschinen vielleicht in der Zukunft richtig denken lernen, berichtet nächsten Donnerstag Marc Rohlfing im HNF. Sein Vortrag „Endlich! Intelligente Computer“ startet am 14. Juni um 18 Uhr; der Eintritt beträgt vier Euro. Ein künstliches neuronales Netz zum Spielen gibt es hier, und dieser Link öffnet einen lesenswerten Zeitschriftenartikel aus den USA über den Google-Übersetzer.